本文希望可以由浅入深地剖析 Agent(智能体)的运行基础,解构 ReAct、Plan and Execute 以及 Reflection 这三大 Agent 架构范式。

基础概念:Agent Loop 与范式转移

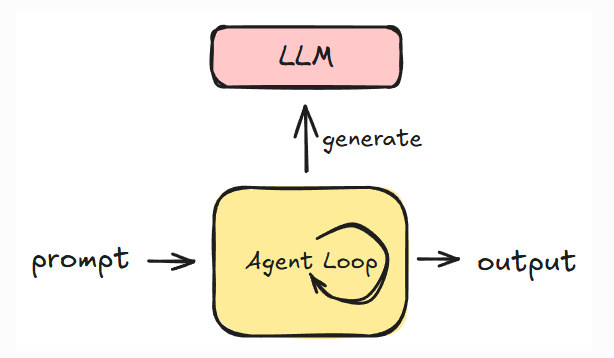

1. 什么是 Agent Loop(智能体循环)?

大语言模型本质上是无状态(Stateless)的概率预测引擎,其推理和感知被局限于单次 API 调用的上下文窗口内。为了使其具备解决现实世界复杂问题的能力,我们引入了 Agent 架构。

Agent 并非只是静态工作流中的一个模型,而是一个包含模型(Models)、工具(Tools)和编排层(Orchestration Layer)的完整应用程序。其核心是一个连续的、周期性的 5 步问题解决循环(Agentic Problem-Solving Process):

- Get the Mission(获取任务): 接收用户或自动化触发器下发的具体宏大目标。

- Scan the Scene(感知环境): 获取可用资源,例如历史上下文、长期记忆或可用工具列表。

- Think It Through(深入思考): 模型作为推理引擎,分析任务与环境并制定推理链。

- Take Action(采取行动): 编排层执行计划的具体步骤(如调用 API、执行代码)。

- Observe and Iterate(观察与迭代): Agent 观察动作返回的结果,将新信息加入记忆,并开启下一轮循环。

2. 从传统工作流到现代 Agent 的本质区别

- 从确定性到随机性(Deterministic vs. Stochastic):在传统的自动化脚本或早期的任务型 Agent 中,开发者扮演着“砖瓦匠(Bricklayer)”的角色,必须硬编码每一个逻辑步骤。而在现代 Agent Loop 中,开发者转变为“导演(Director)”。我们通过系统 Prompt 设定场景、提供 Tools,引导这个自主的“演员”在循环中通过概率推理交付结果。

- 低廉的推理成本替代昂贵的训练成本:过去,训练一个强化学习 Agent 需要通过策略梯度算法在环境中试错并不断更新底层神经网络权重 。现代 Agent 则将预训练好的大模型作为核心推理引擎,利用强大的**上下文工程(Context Engineering)**在上下文窗口中进行零样本或少样本的策略迭代。

Agent 的三大核心范式深度解构

编排层在处理“思考与执行”的逻辑结构上衍生出了不同的经典范式。以下是三种最关键的架构及其底层推导。

1. ReAct (Reasoning and Acting):交错的自回归与环境交互

机制与数学原理:

传统的大模型纯内部自回归容易产生幻觉。ReAct 将“内部认知”与“外部环境交互”耦合,形成一个交错的马尔可夫决策过程(MDP)。Agent 的生成轨迹被重构为 。其中 为行动, 为观察, 为内部思考。

Agent 在时刻 的策略(Policy)定义为基于历史上下文 生成思考和动作的条件概率:

- 出处: Shunyu Yao, et al., 2022, “ReAct: Synergizing Reasoning and Acting in Language Models”。

2. Plan and Execute (Plan-and-Solve):解耦的层次化策略

机制与强化学习映射:

面对长期复杂任务,ReAct 的单步自回归容易导致误差累积。此范式引入层次化强化学习(Hierarchical RL)思想,强制解耦“规划层”与“执行层”。

- 宏观规划:Planner 作为高层策略 ,生成一系列子任务 。此时,RL 的过程奖励模型(PRM)至关重要,它为每一个子步骤的合理性分配奖励 ,而非仅仅评估最终结果。

- 微观执行:Executor 作为底层策略 ,针对每一个 调用工具。系统常表现为多 Agent 协同的“协调者模式(Coordinator pattern)”。

- 出处: Lei Wang, et al., 2023, “Plan-and-Solve Prompting: Improving Zero-Shot Chain-of-Thought Reasoning by Large Language Models”.

3. Reflection (Reflexion):基于语言的反馈闭环

机制与多模态前沿:

Reflection 模仿人类“从失败中学习”,包含 Actor、Evaluator 和 Memory 三个核心组件。

它将传统 PPO 算法中昂贵的梯度更新 替换为通过修改输入上下文实现的策略更新:(其中 是反思记忆)。

在多模态 GUI 导航中,如果 Agent 点击错误,多模态 Evaluator 会对比屏幕截图,提取文本教训(如“按钮应为蓝色”),作为先验知识注入下一轮 Prompt,极大地提升了泛化能力。

架构总结

- ReAct 侧重于步步为营的交替试错。

- Plan and Execute 侧重于高瞻远瞩的解耦与分工。

- Reflection 侧重于吃一堑长一智的反馈循环。